Dataset¶

+Abstract

+SLAM 相关数据集介绍

+Table of Contents¶

+-

+

- TUM +

+

+ 创建日期: + 2024年3月20日 16:09:21 + +

约 1266 个字 预计阅读时间 4 分钟

+Abstract

+TUM RGB-D 数据集由在不同的室内场景使用 Microsoft Kinect 传感器记录的 39 个序列组成,包含了

+等几种针对不同任务的数据集,每个种类有包含多个数据,可以用于多种任务的性能测试。其中之后验证集没有真值,只能通过 TUM 提供的在线测试工具评测我们的计算结果。TUM 数据集带有标准的轨迹和一些比较工具,所以非常适合用来做研究。

+ +可用 ros 的 rosbag 命令进行播放,相应节点订阅图像话题即可。

+压缩后包含:

+Note

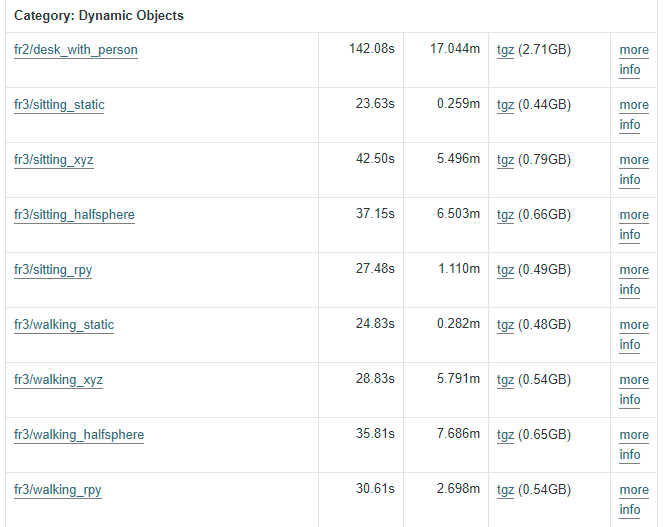

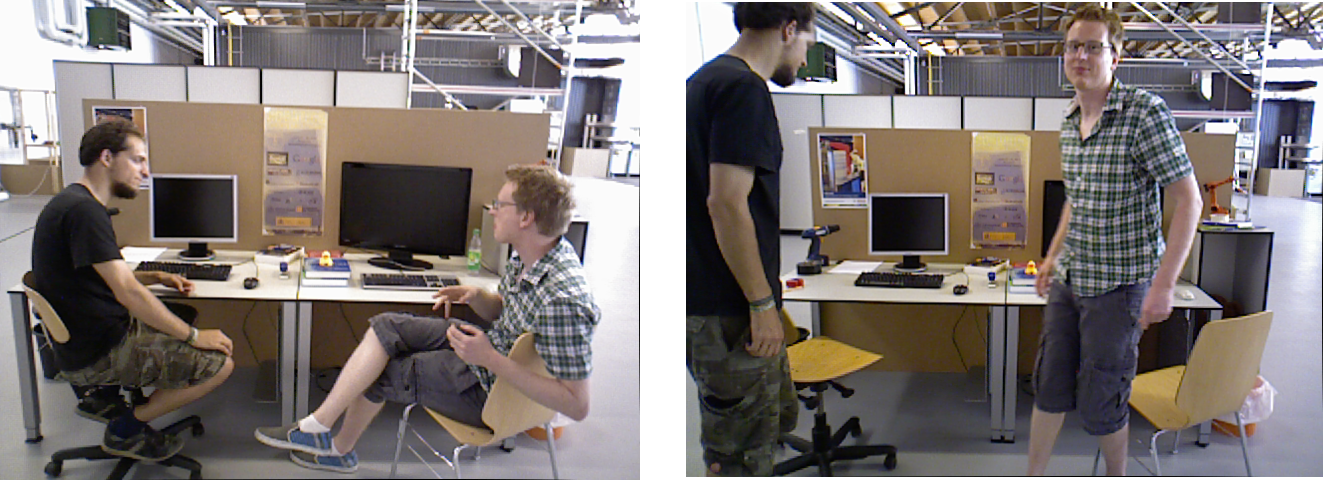

+研究动态 SALM 时用的是 TUM 的 Dynamic Objects 数据集(9 个)以及 Validation Files 对应的部分,如下图所示:

+

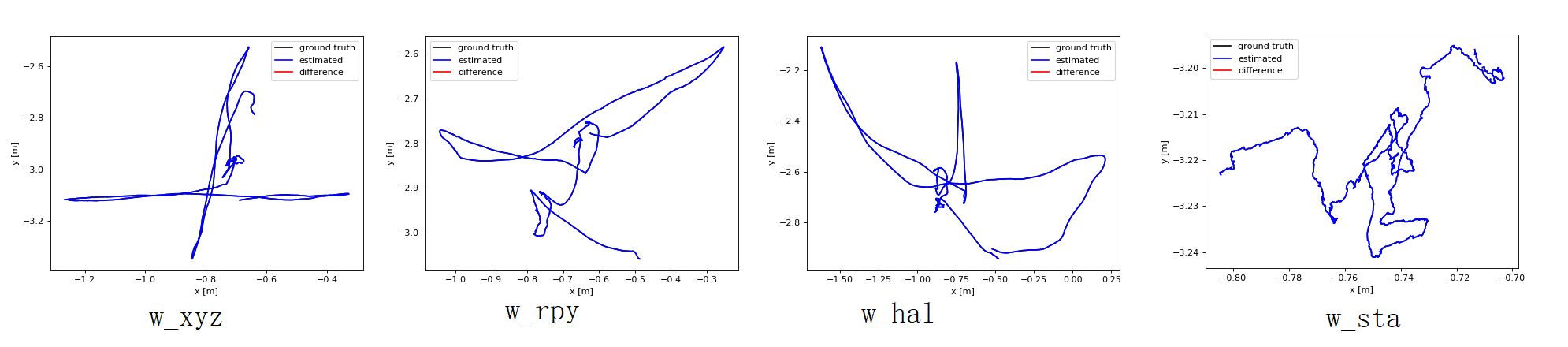

相机运动轨迹的区别如下:

+

对于动态环境下的 SLAM 问题,我们通常遵循以下两个准则来降低动态物体对定位精度的影响。

+在使用语义信息剔除动态区域的时候要考虑的问题:

+针对 TUM 数据集,具体需要考虑的因素包括:

+约 1868 个字 预计阅读时间 6 分钟

+Abstract

+ +在视觉 SLAM 中,动态物体会带来如下挑战:

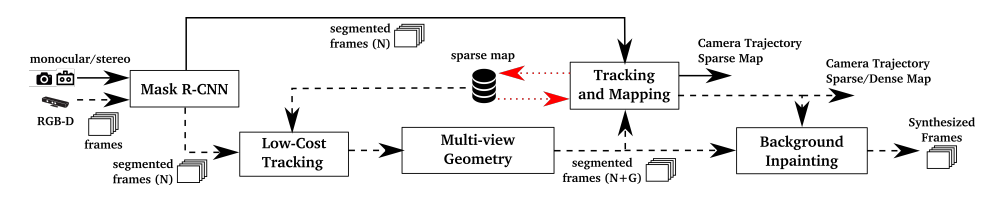

+DynaSLAM 是可以用于单目,双目,RGB-D 的动态 SLAM 系统,相当于是在 ORB-SLAM2 上加了一个前端的模块,上面的两个挑战,这篇论文都给出了对应的解决办法。

+在这个部分作者还总结了一下目前动态 SLAM 的一些方法:

+常规去除动态的外点:

+对于基于特征的 SLAM:

+对于直接法 SLAM,他对动态物体更加敏感:

+上面列出关于特征法和直接法的方案都有一些问题没能解决:

+而 DynaSLAM 不仅可以检测出正在移动的物体,还可以检测出一些“可被移动”的物体。

+

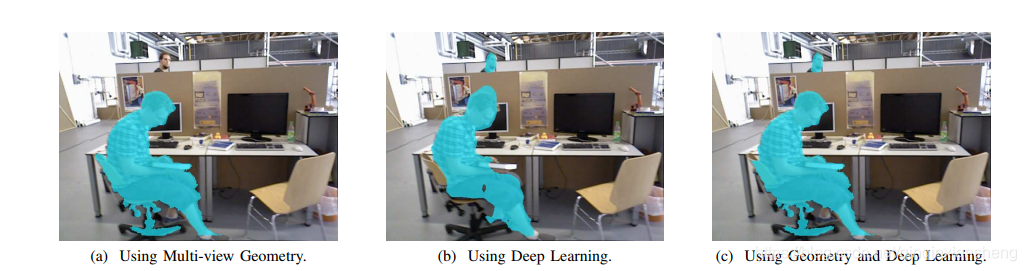

使用 MASK-RCNN 进行像素级分割,只用到语义信息。

+上一步中把动态特征点去除后,用剩下的静态点线求出一个相机的位姿。由于计算特征点的时候,特征点本就喜欢落在分割轮廓这种高梯度区域(可以找图片看一下,比如,人身体分出来的分割边界,后面就是背景,有一些遮挡关系,分割边界附近会是梯度变化大的区域,特征点本身就容易落在这种地方

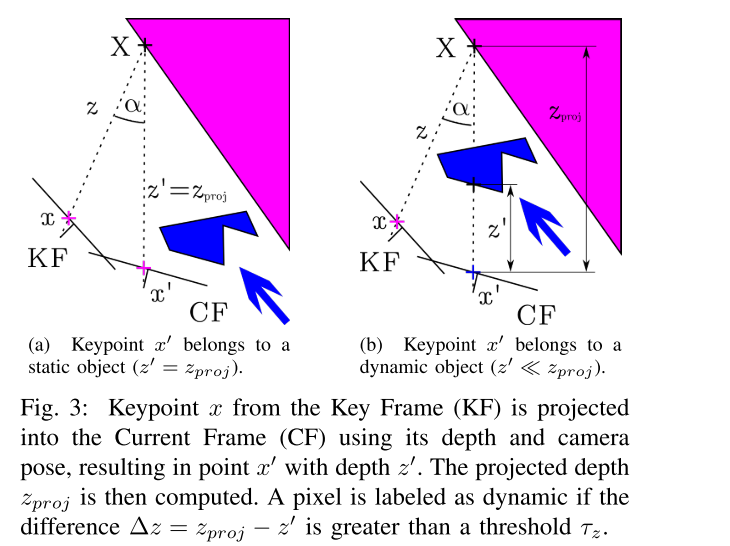

使用 MASK-RCNN 只能分割出先验的动态物体,但是不能找到那些“可以被移动”的物体,比如被人拿着的书,跟人一起移动的转椅等等。为了解决这种情况,就采用了下面的多视图几何的方法:

+

这两种方法呈现出功能上的互补,所以最终取了两个 Mask 的并集,被分割的动态部分被从当前帧和地图中移除:

+这一步中,系统的输入是:RGB 图,深度图像,分割的 Mask。

+在图像中提取出的ORB特征点都被标记为静态点,如果特征点落在了分割轮廓周围(高梯度区域

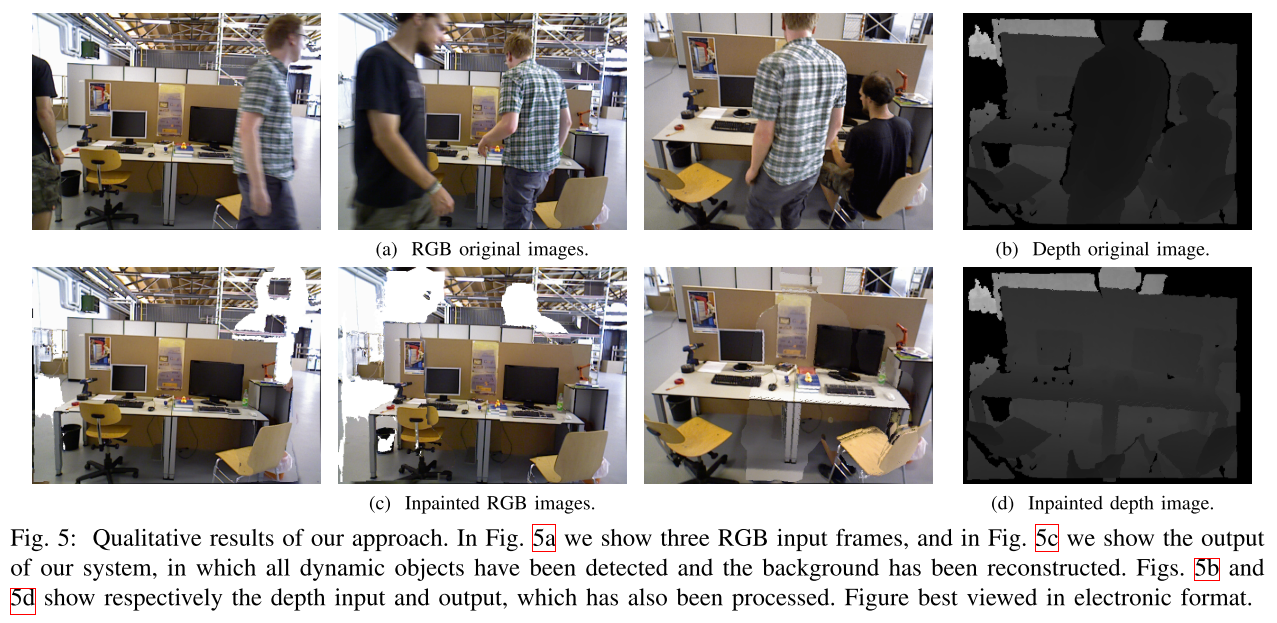

对于每一个被移除的动态物体,希望能用之前视图中的静态信息来补全丢失的背景信息(被动态物体遮挡了的部分

从下面的图 5 可以看到大部分被分割的部分已经用来自静态背景的信息进行了适当的补全。

+

略。

+